Panduan ini memberikan gambaran tentang deep learning untuk pembaca di Indonesia. Tujuannya membantu profesional, mahasiswa, dan praktisi startup memahami konsep ini. Mereka juga akan belajar tentang arsitektur deep neural network dan langkah-langkah implementasi yang relevan untuk bisnis dan riset.

Deep learning adalah bagian dari machine learning yang menggunakan artificial neural networks berlapis. Ini digunakan dalam berbagai aplikasi seperti rekomendasi di Traveloka, prediksi kemacetan di Google Maps, dan fitur suara seperti Siri dan Google Assistant. Contoh ini menunjukkan bagaimana model besar dapat mengubah produk sehari-hari.

Belajar deep learning memerlukan banyak data dan komputasi yang kuat, seperti GPU atau TPU. Model ini sering kali sulit dipahami, sehingga interpretasi dan potensi bias menjadi tantangan penting saat mengimplementasikannya.

Artikel ini bertujuan sebagai panduan perbandingan antara machine learning tradisional dan deep learning. Di bagian selanjutnya, kita akan membahas kapan harus memilih model sederhana atau deep neural network. Kita juga akan membahas praktik training, backpropagation, dan optimasi untuk deployment yang stabil.

Apa Itu Deep Learning?

Deep learning adalah cara canggih dari kecerdasan buatan. Ia menggunakan jaringan saraf tiruan yang banyak lapisan untuk memproses data. Sistem ini bisa mengambil fitur dari data mentah tanpa harus diatur manual.

Deep neural network terdiri dari lapisan yang saling menumpuk. Setiap lapisan belajar hal baru. Mulai dari fitur sederhana seperti warna, sampai konsep kompleks seperti wajah atau kata.

Metode ini sangat cocok untuk tugas yang kompleks seperti citra, audio, dan teks. Sistem deep learning bisa mengerti dan memprediksi dengan akurasi tinggi, seringkali lebih baik dari manusia.

Prosesnya dimulai dari input, lalu melewati banyak lapisan tersembunyi. Akhirnya, ia menghasilkan output yang bisa diprediksi. Ini berbeda dengan metode machine learning yang lebih tradisional.

Untuk membangun sistem ini, dibutuhkan dataset besar dan perangkat keras canggih. GPU atau TPU sangat diperlukan. Teknik optimisasi dan regularisasi juga penting untuk menghindari overfitting.

Beberapa contoh penggunaan deep learning adalah pengenalan wajah di smartphone dan asisten virtual. Deteksi marka jalan untuk kendaraan otonom juga memanfaatkan deep learning. Buku dan literatur akademik memberikan penjelasan dan panduan untuk pengembang.

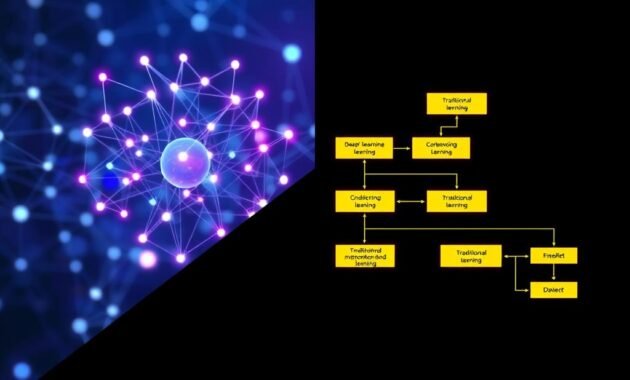

Bedanya dengan Machine Learning Tradisional

Deep learning dan machine learning tradisional berbeda dalam cara belajar model. Pada ML tradisional, kita sering gunakan algoritma seperti regresi dan decision tree. Kita juga butuh melakukan feature engineering manual dari data mentah.

Deep learning, di sisi lain, menggunakan jaringan saraf berlapis. Ini membuat ekstraksi fitur otomatis dari data menjadi lebih mudah. Ini sangat membantu saat data besar dan kompleks.

Pemilihan antara ML dan DL tergantung pada ukuran dan sifat dataset. ML tradisional lebih cocok untuk dataset kecil hingga menengah. Ini karena model seperti decision tree mudah dijelaskan dan cepat diimplementasikan.

Deep learning lebih cocok untuk dataset besar atau tugas yang melibatkan citra, audio, atau teks. Contohnya termasuk klasifikasi citra medis dan sistem visi kendaraan otonom.

Ada beberapa pertimbangan praktis dalam memilih antara ML dan DL. ML lebih transparan dan ringan dari sisi komputasi. DL, di sisi lain, memerlukan GPU atau TPU untuk training dan bisa menjadi “black box”.

Keputusan teknologi ini juga mempengaruhi strategi bisnis dan jalur karier data science. Organisasi dengan sumber daya terbatas mungkin memilih ML. Sementara itu, perusahaan dengan data besar lebih berinvestasi pada DL.

| Aspek | Machine Learning Tradisional | Deep Learning |

|---|---|---|

| Feature engineering | Wajib, manual, memerlukan domain knowledge | Otomatis, model mengekstrak fitur dari data |

| Skala data | Efisien pada dataset kecil hingga menengah | Optimal pada skala data besar |

| Interpretabilitas | Tinggi (mis. decision tree) | Rendah, sering menjadi black box |

| Kebutuhan komputasi | Ringan hingga sedang | Tinggi, memerlukan GPU/TPU untuk training |

| Contoh aplikasi | Rekomendasi e-commerce, deteksi spam | Pengolahan citra, audio, NLP |

| Risiko | Overfitting pada fitur buruk | Bias jika data tidak seimbang; biaya infrastruktur |

Komponen Inti

Bagian ini membahas elemen utama dari deep neural network. Anda akan belajar tentang unit pemroses, lapisan, aktivasi, dan cara mengukur kesalahan model.

Neuron, Layer, Aktivasi, Loss

Neuron adalah unit pemroses yang menerima input. Mereka mengalikan input dengan bobot, menambahkan bias, dan menghasilkan output. Output ini kemudian dikirim ke neuron lain atau ke layer berikutnya.

Layer deep learning terdiri dari input, beberapa lapisan tersembunyi, dan output. Kedalaman layer menentukan kemampuan model dalam membentuk representasi abstrak dari data.

Fungsi aktivasi memperkenalkan non-linearitas. Ini memungkinkan model belajar pola kompleks. ReLU sering digunakan karena sederhana dan mempercepat pelatihan. Sigmoid dan tanh digunakan untuk kasus khusus seperti output probabilitas.

Loss function mengukur seberapa jauh prediksi dari target. Selama pelatihan, optimizer seperti SGD atau Adam menyesuaikan bobot untuk meminimalkan loss function melalui backpropagation.

Dalam CNN, convolutional layer mengekstraksi fitur spasial seperti edge dan kurva. Pooling layer, seperti max pooling, mengurangi dimensi dan membuat representasi lebih tahan terhadap translasi.

Operasi konvolusi dipengaruhi oleh ukuran input W, filter F, padding P, dan stride S. Kombinasi parameter ini menentukan dimensi output dan detail fitur yang ditangkap oleh filter.

Setelah ekstraksi fitur, layer flatten meratakan hasil untuk masuk ke fully connected. Softmax sering digunakan pada output untuk mengubah skor menjadi probabilitas kelas.

Contoh nyata termasuk arsitektur seperti VGG16 yang digunakan dalam deteksi marka jalan. Integrasi ke aplikasi web menggunakan Flask menunjukkan bagaimana komponen inti bekerja dalam pipeline end-to-end untuk aplikasi industri dan riset.

Training: Backpropagation (Ringkas)

Backpropagation adalah inti dari training deep learning. Metode ini menghitung gradien loss terhadap bobot dan bias tiap neuron. Lalu, memperbarui parameter menggunakan algoritma optimasi yang dipilih.

Proses update biasanya memakai gradient descent dalam bentuk mini-batch. Stochastic gradient descent (SGD) dan varian modern seperti Adam sering dipakai sebagai optimizers. Mereka memengaruhi kecepatan konvergensi dan stabilitas training.

Untuk mempercepat dan menstabilkan pelatihan, gunakan batch normalization pada layer yang tepat. Teknik ini menormalkan distribusi aktivasi. Ini membuat pelatihan lebih cepat dan lebih tahan terhadap inisialisasi bobot yang kurang ideal.

Praktik pra-pemrosesan data penting saat training deep learning. Augmentasi, normalisasi, dan resize meningkatkan variasi data. Ini membantu mengurangi overfitting pada dataset terbatas.

Monitoring metrik validasi wajib dilakukan untuk mendeteksi overfitting lebih awal. Simpan checkpoint model setelah epoch yang baik. Ini agar versi terakhir dapat dipakai untuk inferensi di sistem nyata.

Penggunaan GPU mempercepat epoch dan memungkinkan eksperimen dengan arsitektur lebih besar. Kombinasi optimizer yang tepat, batch normalization, dan pra-pemrosesan data membuat pipeline training lebih andal dan efisien.

Arsitektur Populer

Di dunia arsitektur deep learning, ada beberapa pola jaringan yang sering digunakan. Masing-masing memiliki kelebihan dan kekurangan. Ini mempengaruhi seberapa cepat dan akurat mereka bekerja.

Convolutional neural network (CNN) sangat cocok untuk data visual. Mereka bisa mengekstrak fitur spasial dari gambar dan video. CNN sering digunakan untuk deteksi marka jalan dan pengenalan objek.

CNN juga efektif untuk klasifikasi citra medis dan segmentasi gambar. Namun, mereka menghadapi tantangan seperti pencahayaan yang berubah dan distorsi perspektif.

Recurrent neural network (RNN) dan LSTM cocok untuk data berurutan. RNN cocok untuk urutan pendek, sedangkan LSTM mengatasi masalah vanishing gradient. LSTM sering digunakan untuk pemrosesan teks dan speech recognition.

Transformer mengubah cara kerja di NLP dengan menggunakan attention paralel. Model berbasis transformer lebih cepat dan efektif daripada RNN. Mereka populer untuk penerjemahan mesin dan model bahasa besar.

Untuk memilih arsitektur yang tepat, lihat tabel perbandingan. CNN cocok untuk data spasial, RNN dan LSTM untuk urutan pendek, dan Transformer untuk NLP skala besar. Implementasi praktis sering melibatkan layanan web dan solusi penyimpanan hasil.

| Aspek | CNN | RNN / LSTM | Transformer |

|---|---|---|---|

| Domain unggulan | Gambar, video | Teks, sinyal waktu | NLP, pemodelan sekuens skala besar |

| Kekuatan utama | Ekstraksi fitur spasial | Memori urutan panjang (LSTM) | Attention paralel dan konteks global |

| Tantangan praktis | Pencahayaan, perspektif, latensi inferensi | Kesulitan parallelisasi, vanishing gradient (RNN) | Kebutuhan memori besar, optimasi batch |

| Contoh aplikasi | Deteksi marka jalan, klasifikasi medis | Speech recognition, forecasting | Penerjemahan mesin, model bahasa |

| Implementasi produksi | Edge GPU, model pruning | Streaming inference, state handling | Sharding model, quantization |

Tips Training yang Stabil

Untuk training deep learning yang stabil, penting memiliki alur kerja yang teratur. Mulai dari pengelolaan data hingga memilih infrastruktur yang tepat. Setiap langkah sangat mempengaruhi hasil akhir. Berikut ini beberapa tips untuk meningkatkan keandalan model.

Data

Kualitas dan jumlah data sangat penting. Untuk visi komputer, lakukan augmentasi, normalisasi, dan resize. Ini membuat model lebih kuat.

Periksa kelas data secara berkala untuk menghindari bias. Gunakan sampling atau reweighting jika diperlukan.

Regularization

Regulasi penting untuk menghindari overfitting. Gunakan dropout, weight decay (L2), dan early stopping berdasarkan validasi.

Batch normalization mempercepat pelatihan dan stabilkan aktivasi. Ini memungkinkan kita meningkatkan learning rate dengan risiko lebih kecil.

Tuning

Hyperparameter tuning harus dirancang dengan baik. Sesuaikan learning rate, batch size, arsitektur, dan optimizer. Ini membantu mencapai konvergensi yang stabil.

Pilih strategi seperti grid search atau random search. Pantau metrik validasi untuk menemukan konfigurasi terbaik.

Infrastruktur dan Rekayasa Model

Gunakan GPU atau TPU untuk mempercepat pelatihan model besar. Uji pada CPU jika targetnya perangkat edge atau offline.

Manfaatkan pretrained model seperti VGG16 atau ResNet untuk transfer learning. Simpan versi terlatih dan integrasikan ke layanan web seperti Flask.

Ukur FPS dan latency untuk menilai kesiapan real-time. Misalnya, deteksi marka jalan bisa ~14 FPS pada pengaturan offline. Ini belum mencapai target 25–30 FPS karena kondisi belokan dan pencahayaan yang variatif.

Use Case Deep Learning

Deep learning membuka peluang besar untuk aplikasi di berbagai sektor. Misalnya, sistem rekomendasi di Traveloka menyesuaikan tawaran perjalanan dengan preferensi pengguna. Ini meningkatkan engagement pelanggan dengan memadukan model prediksi dan heuristik.

Visi komputer sangat berguna untuk kendaraan otonom dan ADAS. Di Institut Teknologi Nasional Malang, ada studi menggunakan VGG16, OpenCV, dan Flask untuk deteksi marka jalan dari video dashcam. Meskipun deteksi marka jalan berfungsi, masih perlu optimasi untuk inferensi real-time.

Klasifikasi citra medis sangat berpengaruh pada layanan kesehatan. Model deep learning mencapai akurasi yang mendekati spesialis radiologi dalam analisis MRI dan CT. Ini mempercepat triase dan mendukung keputusan klinis tanpa menggantikan tenaga medis.

NLP dan speech membuat asisten suara seperti Siri dan Google Assistant lebih responsif. Transformer dan model besar menangani penerjemahan, klasifikasi teks, serta ekstraksi entitas. Integrasi NLP ke layanan pelanggan mempercepat respons dan meningkatkan kualitas interaksi.

Desain UI/UX mendapat keuntungan dari visi komputer untuk analisis tata letak. CNN dapat mengenali pola visual pada Learning Management System dan memberi rekomendasi desain antarmuka. Aplikasi deep learning ini membantu tim produk membuat iterasi desain lebih cepat.

Implementasi end-to-end kerap memakai kerangka kerja web populer. Integrasi model dengan Flask dan penyimpanan cloud seperti Supabase memungkinkan pipeline dari preprocessing hingga presentasi. Studi implementasi menekankan pentingnya arsitektur untuk inferensi gambar dan video secara andal.

Untuk membantu pemangku kepentingan, ringkasan perbandingan use case berikut merangkum tujuan, teknologi umum, dan tantangan implementasi.

| Use Case | Teknologi Umum | Manfaat Bisnis | Tantangan |

|---|---|---|---|

| Rekomendasi produk dan konten | Collaborative filtering, Transformer, embedding | Meningkatkan konversi dan retensi pengguna | Skalabilitas data dan cold-start |

| Deteksi marka jalan | CNN (VGG16, ResNet), OpenCV, pipeline inferensi | Meningkatkan keselamatan untuk ADAS dan otonom | Latensi real-time dan kondisi pencahayaan |

| Klasifikasi citra medis | CNN, transfer learning, ensemble | Percepat diagnosa dan dukung keputusan klinis | Regulasi, interpretabilitas, kualitas data |

| NLP dan speech | Transformer, BERT, model seq2seq | Otomatisasi layanan, analitik teks | Privasi data dan biaya pelatihan model besar |

| UI/UX pattern recognition | CNN untuk layout detection, clustering | Otomasi desain dan rekomendasi visual | Variasi gaya dan generalisasi antar produk |

| Integrasi ke aplikasi web | Flask, cloud storage, REST API | Penyajian hasil inferensi kepada pengguna akhir | Orkestrasi pipeline dan pemantauan performa |

Keputusan memilih ML tradisional atau deep learning bergantung pada banyak faktor. Ini termasuk jumlah data, kebutuhan interpretabilitas, biaya infrastruktur, dan tujuan bisnis. Perencanaan yang matang memastikan aplikasi deep learning memberi nilai tambah tanpa membebani operasional.

FAQ

Deep learning dan machine learning tradisional memiliki perbedaan utama. Deep learning lebih cocok untuk dataset besar dan masalah kompleks seperti citra atau suara. Namun, untuk dataset kecil atau saat pentingnya interpretabilitas, metode tradisional lebih efisien.

Sebelum memulai deep learning, sebaiknya mempelajari machine learning dulu. Dasar-dasar statistik, regresi, dan feature engineering penting untuk dipelajari. Ini membantu memahami konsep seperti overfitting dan evaluasi model.

Training deep learning menantang karena membutuhkan data besar dan sumber daya komputasi seperti GPU/TPU. Ada juga masalah bias pada data yang tidak seimbang dan keterbatasan interpretabilitas. Untuk mempercepat pelatihan, gunakan batch normalization, dropout, dan optimizers yang sesuai. Transfer learning dengan model pretrained juga membantu.

Model deep learning bisa berjalan real-time jika dioptimalkan dan menggunakan perangkat keras yang mendukung. Deteksi marka jalan menunjukkan kinerja sekitar 14 FPS, cukup untuk analisis offline. Namun, untuk mencapai 25–30 FPS tanpa optimasi masih sulit.

Integrasi model ke aplikasi memerlukan framework seperti Flask. Flask bisa menerima input gambar atau video, memproses dengan model seperti VGG16, dan menyimpan hasil ke layanan cloud seperti Supabase. Ini menjawab banyak pertanyaan umum deep learning bagi pengembang aplikasi di Indonesia.